Google ปล่อย A2UI v0.9 วันนี้ (19 เมษายน 2026) สรุปให้ฟังใน 6 จุด อ่านจบใน 5 นาที ไม่ต้องไปไล่อ่าน spec เอง

ย้อนไปไม่กี่ปี คุยกับ AI agent ก็คือได้ข้อความยาวเหยียดกลับมา ต้องอ่านเอง สรุปเอง กดลิงก์เอง งานหนักตกอยู่ที่คนใช้ทั้งหมด บางทีถามคำถามง่ายๆ ก็ได้คำตอบยาวเป็นหน้าจอเต็ม ขี้เกียจอ่านเฉยเลย

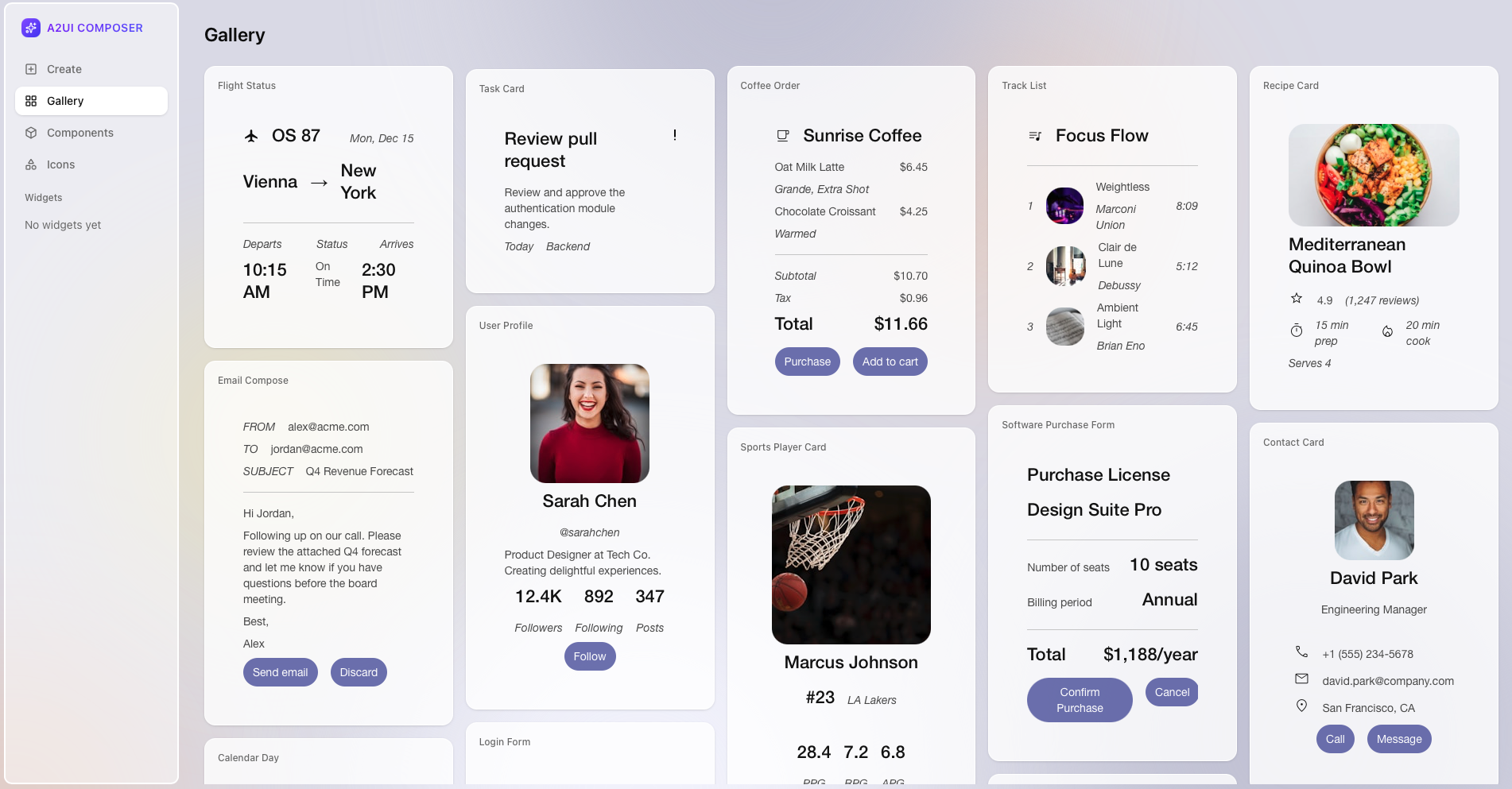

A2UI เปลี่ยนเรื่องนี้ แทนที่จะตอบเป็น text อย่างเดียว ตัว agent จะสั่งแอปของเราให้วาดหน้าจอขึ้นมาเลย ปุ่ม card form ของจริง ไม่ใช่แค่ตัวอักษร ที่สำคัญกว่านั้น Google ปล่อยเป็น open standard ใช้ได้ข้าม framework ข้าม platform และจุดชนวนสงครามมาตรฐานใหม่ที่จะตัดสินว่า AI app รุ่นต่อไปจะหน้าตาแบบไหน

A2UI ย่อให้ใน 6 ข้อที่ต้องรู้

1. เป็น open standard ไม่ผูกกับ framework ไหน Google ปล่อยเป็นมาตรฐานเปิด รองรับ React, Flutter, Lit, Angular ทีมที่ใช้ stack ไหนอยู่ก็เอามาต่อได้เลย ไม่ต้องย้ายค่ายก่อน

2. Agent ไม่ส่ง code มาให้รัน มันส่งคำอธิบาย UI เป็น JSON แบบ declarative (บอกว่าอยากได้อะไร ไม่ได้บอกว่าต้องทำยังไง) แล้วแอปของเราเอาไป render เอง ฝั่งแอปยังคุมทุกอย่างเหมือนเดิม

3. แอปมี catalog ของ component ที่อนุญาตไว้ล่วงหน้า agent จะขอได้แค่ของในนี้ Card Button TextField หรืออะไรก็ตามที่ทีม dev อยาก expose (เปิดให้ใช้) ออกไป ถ้าไม่มีในเมนู agent ก็หยิบไม่ได้

4. มี Agent SDK ตัวใหม่พร้อมใช้ ตอนนี้ ship เป็น Python แล้ว Go กับ Kotlin Google บอกว่ากำลังทำอยู่ ยังไม่บอกวันชัดเจน

5. v0.9 เพิ่มของใหม่ 3 อย่าง client-defined functions (ให้ agent เรียกฟังก์ชันฝั่งแอปได้), client-server data syncing (sync ข้อมูลระหว่างทั้งสองฝั่ง) และ error handling ที่ดีขึ้น

6. เริ่ม integrate กับเจ้าอื่นแล้ว Google รายงานว่าเชื่อมกับ AG2, A2A 1.0, Vercel json-renderer และ Oracle Agent Spec พร้อมโชว์ sample app 2 ตัว Personal Health Companion จาก Rebel App Studio กับ Life Goal Simulator จาก Very Good Ventures

บริกรเลือกจากเมนู ไม่ใช่ลงมือทำอาหารเอง

ลองนึกถึงร้านอาหารสิ เมนูมี 50 จาน ครัวทำเป็นแค่ 50 จานนี้ บริกรรับออเดอร์ได้ แต่เข้าครัวทำกับข้าวเองไม่ได้ ลูกค้าอยากกินอะไรแปลกๆ บริกรก็ชี้เมนูให้ดู บอกว่าอันนี้มีในร้าน เอาไหมล่ะ

A2UI ทำงานแบบเดียวกันเลย แอปของเราคือร้าน catalog ของ component คือเมนู agent คือบริกรที่ชี้ได้แค่ของที่มีในเมนู ห้ามคิดเมนูเอง ห้ามใส่จานแปลกๆ ที่ร้านไม่เคยอนุมัติไว้

ข้อดีคือทีม dev ควบคุม UX ได้ทั้งหมด agent จะไม่งอกปุ่มสี neon สุดซ่าเอง หรือหน้าจอที่หน้าตาไม่เข้ากับ design system ของทีม เพราะมันเลือกได้แค่จากของที่เราอนุญาตไว้แล้ว

อีก analogy ที่เห็นภาพคือ LEGO agent ไม่ได้หล่อบล็อคเองนะ มันส่ง blueprint มาว่า "เอาบล็อคพวกนี้ประกอบเป็นรูปนี้" LEGO set ไหนที่เข้ากันได้ (React, Flutter, Lit, Angular) ก็รับ blueprint เดียวกันไปประกอบในสไตล์ของตัวเองได้หมด agent ตัวเดียวทำงานได้ทุก platform โดยไม่ต้องเขียน UI ใหม่

จุดที่ A2UI ต่างจาก iframe ของค่ายอื่น

Richard MacManus จาก The New Stack เขียนไว้ว่าตอนนี้มาตรฐาน AI agent UI เยอะจนงงมาก A2UI, MCP Apps, MCP-UI, Apps SDK, AG UI, A2A ทุกตัวพยายามแก้ปัญหาเดียวกันจากคนละมุม เขาบอกตรงๆ ว่า "สับสนในบางครั้งว่าใครทำอะไร" ก่อนเข้าปี 2026 คนที่ตามวงการนี้อยู่คงเข้าใจความรู้สึกดี

แบ่งง่ายๆ ได้ 2 ค่ายใหญ่

ค่าย web-centric (OpenAI, Anthropic) agent ส่ง mini web page กลับมา แอปเอาไปโชว์ใน sandboxed iframe (กล่องเว็บเล็กๆ ที่กันไม่ให้โค้ดหลุดออกมารันในแอปจริง) เหมือนฝัง browser ขนาดเล็กอยู่ในแอป ข้อดีคือเขียนเป็นเว็บธรรมดา ใช้ของเดิมที่มีอยู่แล้วได้เลย

ค่าย native-first (Google A2UI) agent ส่งแค่ blueprint แอปเอาไป render ด้วย component ของตัวเอง ผลคือหน้าจอเป็น native 100% ไม่ใช่เว็บปลอมซ้อนในแอป แอปกับ agent กลืนกันเนียน ไม่มีรอยต่อแปลกๆ

Minko Gechev ของ Google บอกผ่าน The New Stack ว่าจุดขายของ A2UI คือ agent "ส่งคำอธิบายของ component ไม่ใช่ code" เลยวิ่งข้าม platform ได้ agent เดียวกันพอไปอยู่บน web ก็ดูเป็นเว็บ บน Flutter ก็ดูเป็น native mobile บน Angular ก็ดูเป็น Angular ทีม dev ไม่ต้องเขียน UI ใหม่ให้แต่ละ platform

Google ยังโปรโมต "progressive rendering" อีกจุด คือคนใช้เห็นของบนหน้าจอทีละชิ้นทันที ไม่ต้องรอ iframe โหลดเสร็จทั้งก้อนก่อน อันนี้ถ้าทำได้จริงก็น่าสนใจอยู่นะ เพราะ latency (ความหน่วง) คือปัญหาใหญ่ของ agent app หลายตัวตอนนี้ ผู้ใช้รู้สึกช้าก็เลิกใช้เลย

สงครามมาตรฐานเพิ่งเริ่ม ใครเดิมพันอะไร

อันนี้โคตรน่าสนใจ เพราะสงครามนี้ไม่ได้แค่ว่า tool ไหนดีกว่าในรายละเอียด มันคือการวาง bet ว่า "AI app" ในอีก 5-10 ปีข้างหน้าจะหน้าตาแบบไหน ใครได้วาง layer นี้ก่อน อาจคุมทิศทางทั้ง ecosystem ไปเลย

Adam Shea จาก TELUS Digital อ้างผ่าน The New Stack ตั้งข้อสังเกตว่ากลยุทธ์ web-focused ของ OpenAI อาจจะเป็นแค่ของชั่วคราว เพราะมีข่าวลือว่า OpenAI เตรียมทำ smartphone platform ของตัวเอง ถ้าจริง เขาคุม platform ได้เองเลย ไม่ต้องพึ่ง iframe ไม่ต้องพึ่งมาตรฐานกลางของใคร

Google เดินสวนทาง เลือก native ข้าม platform ตั้งแต่แรก เหมือนวาง bet ว่าอนาคตคนใช้ AI จะผ่านแอปหลายแบบ ไม่ใช่แค่ผ่านเว็บหรือแชต ของเขาต้อง run ได้ทุกที่ตั้งแต่วันแรก ไม่ใช่ retrofit ทีหลัง

ฝั่ง MCP Apps ที่ OpenAI กับ Anthropic push กันอยู่ก็ไม่ได้แย่ ของเขาเน้นใช้ของเดิมที่มีอยู่แล้ว dev web ทุกคนทำได้โดยไม่ต้องเรียนของใหม่ เลยขยายตัวได้เร็ว

ใครชนะยังไม่รู้ล่ะ แต่การที่ Google เปิด spec เป็น open standard มันมีน้ำหนักทาง psychology กับ dev ส่วนใหญ่ชอบของเปิดมากกว่าของปิด ประวัติศาสตร์ web ก็เล่าเรื่องนี้ซ้ำแล้วซ้ำเล่า

ทีมไทยที่ทำ agent product เริ่มตรงไหนดี

ถ้าคุณเป็น office worker ที่ใช้ AI ทุกวัน เรื่องนี้จะเริ่มเห็นผลในไม่กี่เดือนข้างหน้า แอปที่คุยด้วยจะตอบกลับเป็นหน้าจอจริง มีปุ่มให้กด มี form ให้กรอก มี card ให้เลือก ไม่ใช่ข้อความยาวๆ ที่ต้องอ่านเอง ประสบการณ์ใช้จะใกล้เคียงแอปทั่วไปมากขึ้น จนบางทีลืมไปเลยว่ากำลังคุยกับ AI

ถ้าคุณเป็น dev หรือ product team ที่กำลังทำ agent product มีอยู่ 3 เรื่องที่ควรคิดตั้งแต่ตอนนี้

เรื่องแรก ย้าย mental model จาก "ออกแบบหน้าจอ" เป็น "ออกแบบ component catalog" คิดเหมือนสร้าง design system ในตัว แต่ผู้ใช้คือ agent ไม่ใช่ดีไซเนอร์มนุษย์ agent ต้องเข้าใจว่าแต่ละ component ใช้ทำอะไร metadata ต้องชัด ชื่อต้องสื่อ ถ้า agent งง มันจะเลือก component ผิด UX ก็พังทันที

เรื่องที่สอง Security model แบบ whitelist เป็นจุดแข็งที่เอาไปขายได้ เพราะ agent เลือกได้แค่จากที่เราอนุญาต โอกาสโดน prompt injection ให้มันยัด UI แปลกๆ เข้ามาจะต่ำกว่า approach แบบ iframe ที่ต้อง sandbox ทีหลัง อันนี้เอาไปคุยกับทีม security ในองค์กรได้เลย ใครทำ fintech หรือ healthcare น่าจะได้ใจ compliance team ไม่ยาก

เรื่องที่สาม อย่าเพิ่ง lock-in ตัวเอง A2UI เปิด source และ framework-agnostic ก็จริง แต่ MCP Apps ของ OpenAI กับ Anthropic ก็ยังไม่ตาย ทีมที่ทำ product ควรออกแบบ layer ให้แยก business logic ออกจาก UI contract ไว้ก่อน จะได้ swap ได้ถ้าตลาดเปลี่ยนทิศในอีก 2 ปี ไม่ต้องเขียนใหม่ทั้งระบบ

Google วางหมัดฝั่ง declarative คำถามคือใครตาม

ถ้าให้เดาตรงๆ A2UI จะไม่เป็นผู้ชนะเดี่ยวในปีนี้ ตลาดยังมี 2-3 มาตรฐานแข่งกันอีกพักใหญ่ แต่การที่ Google วางของไว้ฝั่ง declarative + native-first + open มันส่งสัญญาณว่าอนาคตของ AI app ไม่ใช่แค่ chat ยาวๆ อีกต่อไป มันคือหน้าจอจริงที่ generate จาก context ของ user

dev คนไหนที่ยังออกแบบ UI ให้ agent โดยคิดว่ามันจะตอบแค่ text อาจจะเริ่มล้าหลัง เริ่มคิดเรื่อง component catalog ตั้งแต่ตอนนี้ ดีกว่าต้อง refactor ทั้งระบบตอนที่มาตรฐานนิ่งแล้ว ตอนนั้นคู่แข่งขึ้นนำไปไกลแล้ว

อยากลองของจริง เริ่มที่ A2UI.org ตามที่ Google บอกไว้ ได้ทั้ง docs และ sample app ที่โชว์ Agent SDK ตัว Python พร้อมใช้แล้ว ส่วน Go กับ Kotlin รอกันอีกหน่อยนะ อย่าลืมไปส่อง repo google/A2UI บน GitHub ด้วย มี source code ให้อ่าน