ช่อง Matt Wolfe สรุปข่าว AI ประจำสัปดาห์ในคลิป weekly roundup ความยาวราว 33 นาที โดยเปิดด้วยโมเดลใหม่จากบริษัทที่หลายคนไม่คาดคิด นั่นคือ Thinking Machines Labs บริษัทที่ก่อตั้งโดย Mira Murati อดีต CTO ของ OpenAI เธอเคยรับตำแหน่งรักษาการ CEO อยู่ช่วงสั้นๆ ตอน Sam Altman ถูกปลดเมื่อปลายปี 2023 ก่อนออกมาตั้งบริษัทใหม่พร้อมทีมงานจาก OpenAI, DeepMind และ Anthropic ตามที่ Matt Wolfe เล่าไว้ในคลิป สัปดาห์นี้ Thinking Machines Labs เปิดตัว interaction model ตัวแรกในรูปแบบ demo ที่ทำได้มากกว่าแค่ขยับ benchmark ทีละนิดแบบโมเดลภาษาส่วนใหญ่ช่วงหลัง นอกจากข่าวเด่นนี้ คลิปเดียวกันยังครอบคลุมข่าวรองอีกหลายเรื่องจาก OpenAI, Anthropic, Google และบริษัทอื่นๆ บทความนี้สรุปและเล่าตามโครงของคลิป Matt Wolfe ทั้งหมด

Thinking Machines Labs เปิด interaction model ที่ทำได้มากกว่า benchmark

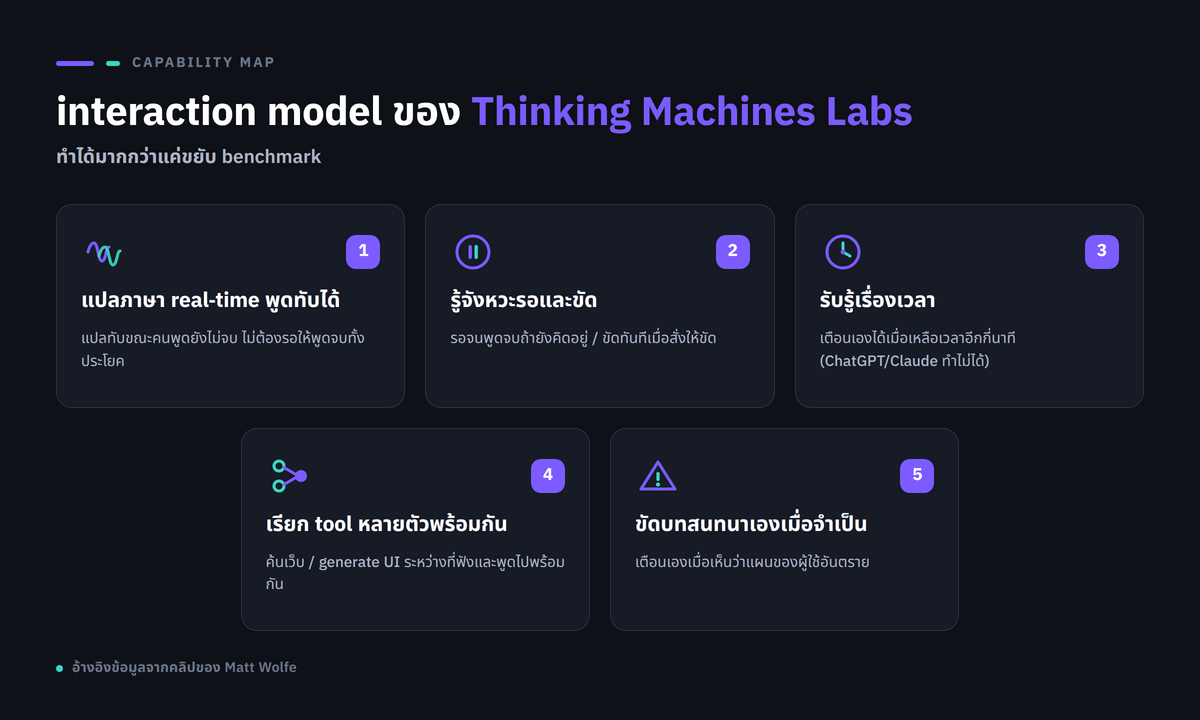

Matt Wolfe ระบุว่า Thinking Machines Labs เงียบไปพักใหญ่หลังตั้งบริษัท ก่อนออกมาโชว์ interaction model พร้อม demo หลายชุดในสัปดาห์นี้ เหตุผลที่คลิปยกให้เป็นข่าวเด่นคือความสามารถที่ต่างจากโมเดลภาษาทั่วไป โดยเฉพาะการแปลภาษาแบบ real-time ที่โมเดลพูดทับคนพูดต้นทางได้ทันทีโดยไม่ต้องรอให้พูดจบ ในตัวอย่างที่ Matt Wolfe ยกมา ผู้พูดสั่งให้โมเดลแปลเป็นภาษาอังกฤษให้เพื่อนและผู้ชมไปพร้อมกับที่ตัวเองกำลังพูด โมเดลก็ทำตามได้ทันที

demo อีกชุดแสดงให้เห็นว่าโมเดลรู้จังหวะของการสนทนา เมื่อผู้พูดหยุดคิดกลางประโยค โมเดลจะไม่รีบขัด แต่รอจนผู้พูดพูดต่อจนจบแล้วค่อยตอบ ในตัวอย่างเดียวกัน ผู้พูดสั่งให้โมเดลขัดทันทีทุกครั้งที่ได้ยินชื่อสัตว์ระหว่างเล่าเรื่อง โมเดลก็นับจำนวนสัตว์ที่เอ่ยถึงไปพร้อมกับฟัง แล้วสรุปยอดรวมตอนจบได้ถูกต้อง นอกจากนี้ยังมี demo ที่โมเดลคอยเตือนเมื่อผู้ใช้นั่งหลังค่อม และ demo ที่โมเดลขัดบทสนทนาเองเมื่อเห็นว่าจำเป็น เช่น ตอนผู้พูดวางแผนพาพ่อแม่อายุเกือบ 80 ไปปั่นจักรยานเสือภูเขาบนภูเขาไฟที่ยังคุกรุ่น โมเดลจึงขัดขึ้นมาเพื่อเตือนว่าอันตรายและแนะนำให้เลือกกิจกรรมที่ปลอดภัยกว่า

Matt Wolfe ชี้ว่าโมเดลตัวนี้ยังมีคุณสมบัติอื่นที่น่าสนใจ เช่น การรับรู้เรื่องเวลา ผู้ใช้สั่งให้บอกเมื่อเหลือเวลาอีก 4 นาทีครึ่งก่อนต้องจบบทสนทนาได้ ซึ่งเป็นสิ่งที่ ChatGPT และ Claude ทำไม่ได้ รวมถึงการเรียก tool หลายตัวพร้อมกัน โมเดลสามารถค้นเว็บ เปิดดูข้อมูล หรือ generate UI ระหว่างฟังและพูดกับผู้ใช้ แล้วนำผลลัพธ์กลับเข้ามาในบทสนทนาแบบ real-time แต่โมเดลนี้ยังไม่เปิดให้ใช้งานทั่วไป ทาง Thinking Machines Labs ระบุว่าจะเปิด research preview แบบจำกัดในอีกไม่กี่เดือนข้างหน้า แล้วค่อยปล่อยให้ใช้กว้างขึ้นภายในปีนี้ ตามที่ Matt Wolfe สรุปไว้

ข่าวจาก OpenAI: Codex บนมือถือ และ Daybreak

ในฝั่ง OpenAI Matt Wolfe เล่าว่าฟีเจอร์ที่เขาตื่นเต้นมากที่สุดสัปดาห์นี้คือ Codex ใช้งานจากมือถือได้แล้ว หลังตั้งค่า Codex mobile ผ่านการสแกน QR code และอนุญาตให้อุปกรณ์เชื่อมกับคอมพิวเตอร์ ผู้ใช้จะสั่งงาน Codex จากแอปบนมือถือได้ ขณะที่ไฟล์ยังอยู่บนเครื่องเดิม ในคลิปมีตัวอย่างการเปิด chat session ที่เริ่มไว้บนคอมพิวเตอร์แล้วถามต่อจากมือถือ ซึ่ง Codex อ่านข้อมูลจากเครื่องจริงและทำงานพร้อมกันทั้งสองฝั่ง ตามที่ Matt Wolfe นำเสนอ ประโยชน์หลักคือคนที่เขียนโค้ดด้วย Codex สามารถสั่งงานทิ้งไว้แล้วไปทำอย่างอื่น จากนั้นกลับมาเช็กความคืบหน้าหรือตอบคำถามจากมือถือได้โดยไม่ต้องนั่งอยู่หน้าเครื่อง

ข่าวที่สองจาก OpenAI ในคลิปคือ Daybreak ซึ่ง Matt Wolfe มองว่าเป็นคำตอบของ OpenAI ต่อ Mythos ของ Anthropic ในด้านความปลอดภัยทางไซเบอร์ จุดต่างที่คลิปชี้ให้เห็นคือวิธีเปิดให้ใช้งาน Anthropic เลือกสร้างโมเดลที่หาช่องโหว่ด้านความปลอดภัยได้ แล้วคัดเลือกว่าใครได้ใช้ โดยจำกัดเฉพาะผู้เชี่ยวชาญด้านความปลอดภัยที่ไว้ใจได้ ส่วน OpenAI เลือกให้ผู้ใช้ขอให้ OpenAI สแกนหาช่องโหว่ให้ แทนการส่งมอบเครื่องมือไปให้ใช้เอง ตามที่ Matt Wolfe อธิบายไว้ในคลิป

ข่าวจาก Anthropic: agent view, การเปลี่ยน credit ที่ชุมชนมองว่าเป็น nerf และการแซง OpenAI

Matt Wolfe เล่าว่า Anthropic ออกฟีเจอร์ใหม่ใน Claude Code ชื่อ agent view สำหรับผู้ใช้ผ่าน command line เมื่อสั่งให้ Claude Code spin up agent หลายตัวพร้อมกัน ผู้ใช้ไม่ต้องเปิดหน้าต่าง terminal หลายบาน เพราะ agent view จะรวมทุกตัวไว้ในหน้าจอเดียว เพื่อให้เห็นว่า agent ตัวไหนกำลังทำงาน ตัวไหนต้องการ input และตัวไหนเสร็จแล้ว ช่วยให้ layout สะอาดขึ้นเมื่อใช้ agent จำนวนมากพร้อมกัน

ประเด็นที่คลิปให้น้ำหนักมากกว่าคือการเปลี่ยนระบบ subscription ของ Claude Matt Wolfe ระบุว่า Anthropic ประกาศเพิ่ม weekly limit ของ Claude Code ขึ้น 50% ถึงวันที่ 13 กรกฎาคม แต่ในสัปดาห์เดียวกันก็ประกาศว่า ตั้งแต่วันที่ 15 มิถุนายน จะเปลี่ยนวิธีคิด subscription สำหรับการใช้ Claude นอก Claude Code เช่นผ่าน OpenClaw หรือ Hermes แต่ละแผนจะได้ credit จำนวนหนึ่งต่อเดือน และเมื่อ credit หมดจะเริ่มคิดเงินที่ API rate ตามที่ Matt Wolfe นำเสนอ Anthropic สื่อสารเรื่องนี้ในเชิงข่าวดีว่าผู้ใช้จะไม่ถูกตัดการใช้งานทันทีเมื่อ credit หมด แต่ thread ในชุมชนที่คลิปอ้างถึงมองต่างออกไป โดยระบุว่านี่คือการ nerf ครั้งใหญ่ ไม่ใช่ฟีเจอร์ใหม่ เพราะ credit ถูกคิดที่ API rate ที่แพง ทำให้ credit มูลค่า $100 หรือ $200 ใช้งานได้น้อยกว่าเดิมมาก มีผู้คำนวณว่าจะหมดภายในไม่กี่ชั่วโมงหากใช้งานหนัก จนแทบใช้ทำงาน dev จริงจังไม่ได้

Note: Matt Wolfe สรุปจุดที่ชุมชนกังวลว่า การได้ credit เพิ่มแล้ว roll เข้า API billing หมายความว่าผู้ใช้ third-party app ที่ build บน agent SDK เช่น OpenClaw หรือ Hermes มีโอกาสถูกคิดเงินสูงขึ้น

แม้หลายคนจะไม่พอใจกับแผนเหล่านี้ Matt Wolfe ชี้ว่า Anthropic กลับแซง OpenAI ด้านการใช้งานในองค์กรเป็นครั้งแรกในเดือนนี้ โดยอ้างข้อมูลจากบทความของ Ramp ที่ระบุว่าการใช้งาน Anthropic เพิ่มขึ้น 3.8% ในเดือนเมษายนเป็น 34.4% ของธุรกิจ ขณะที่ OpenAI ลดลง 2.9% เหลือ 32.3% คลิปยังเล่าว่า Anthropic เดินเกมเจาะอุตสาหกรรมทีละกลุ่ม สัปดาห์นี้ประกาศ Claude for legal สำหรับวงการกฎหมาย โดยปล่อย MCP connector และ plugin เฉพาะอุตสาหกรรม ก่อนหน้านี้ Anthropic ทำแนวทางนี้มาแล้วกับอุตสาหกรรมการเงิน สุขภาพ งานออกแบบและงานสร้างสรรค์ และความปลอดภัยทางไซเบอร์ รวมถึงเปิด Claude for small business ใน Claude Cowork ที่มี agent สำเร็จรูปสำหรับงานการเงิน operations การขาย การตลาด HR และ customer service พร้อมเชื่อมต่อเครื่องมืออย่าง PayPal, QuickBooks, HubSpot, Canva และ DocuSign

Matt Wolfe ยังหยิบเคสน่าสนใจจาก Anthropic มาเล่า ผู้ใช้รายหนึ่งบน X บอกว่าสามารถเข้าถึง Bitcoin wallet เก่าที่พยายามปลดล็อกมานานกว่า 12 ปีได้สำเร็จด้วยความช่วยเหลือจาก Claude เจ้าตัวลองทุ่มข้อมูลจากคอมพิวเตอร์สมัยเรียนทั้งเครื่องเข้าไปใน Claude แล้ว Claude ก็เจอไฟล์ wallet เก่าที่ถอดรหัสด้วย mnemonic ได้สำเร็จ หลังถูกล็อกออกมานานกว่า 11 ปีเพราะลืมรหัสผ่านที่เปลี่ยนไว้เอง ตามที่ Matt Wolfe เล่าจากโพสต์บน X

ข่าวฝั่งรูป วิดีโอ และ 3D: Krea 2 และ World Labs

Matt Wolfe เล่าว่าสัปดาห์นี้มีโมเดลภาพใหม่จาก Krea AI ชื่อ Krea 2 คลิปมองว่าฟังก์ชันควบคุมสไตล์ของโมเดลนี้คล้ายกับ Midjourney ผู้ใช้ส่งภาพให้แล้วสั่งให้ทำสไตล์ตามภาพนั้นได้ พร้อมปรับระดับความเข้มของสไตล์ผ่าน slider ถ้าใส่หลายภาพก็ปรับน้ำหนักของแต่ละสไตล์ได้ นอกจากนี้ Krea 2 ยังมีฟีเจอร์ mood board ที่ให้ใส่ภาพชุดที่มีสไตล์คล้ายกันเข้าไป ระบบจะวิเคราะห์ออกมาเป็น taste profile พร้อม keyword และสิ่งที่ควรหลีกเลี่ยง แล้ว generate ภาพที่เข้ากับ mood นั้น ตามที่ Matt Wolfe สาธิตในคลิป ฟีเจอร์นี้เปิดให้ผู้ใช้แผน Max หรือ business เข้าถึงได้แล้ว

อีกชิ้นที่คลิปหยิบมาคือ World Labs โครงการ open source ที่รับภาพ input หนึ่งภาพแล้ว generate เป็น environment ครบทั้ง mesh, physics, lighting และ audio ในตัวอย่างที่ Matt Wolfe แสดง ระบบแยกวัตถุในห้องออกมา เปลี่ยนห้องให้เป็น 3D ที่ขยับมุมมองได้ และทำให้วัตถุต่างๆ เคลื่อนย้ายและโต้ตอบได้ ทั้งหมดเริ่มจากภาพเดียว Matt Wolfe ระบุว่า World Labs ใช้งานผ่าน Claude Code และเปิดให้ดาวน์โหลดบน GitHub ขั้นตอนคือ clone repo แล้วรัน Claude Code จากนั้นสั่ง prompt ให้ทำงานทีละขั้น ระบบจะสร้าง 3D model, Gaussian splat และเสียง ambient ออกมาให้

ข่าวจาก Google: Android agentic, Google book และ Google IO ที่กำลังจะมาถึง

Matt Wolfe เล่าว่า Google จัดงาน Android event ในสัปดาห์นี้ พร้อมประกาศอัปเดตหลายอย่างของ Android และเปิดตัว Google book ในฝั่ง Android คลิปยกตัวอย่างการถ่ายรูป flyer ของอีเวนต์หนึ่ง แล้ว Gemini จัดการต่อจนถึงขั้นตอนสุดท้ายที่เปิดแอป Expedia ให้กดจองได้เลย อีกตัวอย่างคือการใช้ปุ่ม Gemini บน Chrome ของ Android ที่ดึง context ของหน้าเว็บที่กำลังดูเข้ามา แล้วสั่งให้จองที่จอดรถผ่าน SpotHero โดย Gemini navigate ไปกรอกข้อมูลและพาไปถึงหน้าจ่ายเงินด้วย Google Pay ตามที่ Matt Wolfe นำเสนอ นอกจากนี้ Android ยังเพิ่มความสามารถในการกรอกฟอร์มด้วยการกดปุ่มเดียว โดยใช้ข้อมูลอย่าง passport หรือใบขับขี่ และปรับการพิมพ์ด้วยเสียงให้ตัดคำติดอ่างกับคำเกินออกคล้ายกับ Whisper Flow

Matt Wolfe อธิบายว่า Google วาง Google book เป็นวิวัฒนาการถัดไปของ Chromebook โดยเปรียบเทียบว่าเมื่อ 15 ปีก่อน Google เปิดตัว Chromebook และตอนนี้เมื่อโลกขยับจาก operating system ไปสู่ intelligent system จึงต้องคิดเรื่อง laptop ใหม่ Google book ยังใช้ Chrome OS แต่ฝังฟีเจอร์ AI ที่เห็นบน Android เข้าไป คลิปยังยกตัวอย่าง reimagining mouse pointer ที่ผู้ใช้ highlight ข้อความบนสูตรอาหารแล้วคลิกที่ shopping list เพื่อเพิ่มของโดยไม่ต้องพิมพ์ รวมถึงการแก้ภาพและเอกสารด้วยการ highlight แล้วสั่งด้วยเสียง และตัวอย่างที่ใช้ eye tracking สั่งย้ายวัตถุโดยไม่ต้องใช้เมาส์ ตามที่ Matt Wolfe สาธิตในคลิป

Matt Wolfe ปิดท้ายว่าสัปดาห์หน้าจะมีงาน Google IO ที่ Mountain View และเขาจะไปร่วมงานด้วย ส่วนข่าวลือที่คลิประบุชัดว่ายังไม่ยืนยัน ได้แก่ Gemini 3.2 Flash ที่ว่ากันว่าทำงานด้าน coding และ reasoning ได้ราว 92% ของ GPT 5.5 แต่ถูกกว่า 15 ถึง 20 เท่าและเร็วกว่า รวมถึง Gemini Spark agent ที่จะทำหน้าที่เป็นผู้ช่วยทำงานต่อเนื่องคล้าย OpenClaw หรือ Hermes และความเป็นไปได้ของอัปเดต Google glasses ที่มี display ในตัว ทั้งหมดนี้เป็นเพียงข่าวลือที่ Matt Wolfe ย้ำว่ายังไม่มีรายละเอียดยืนยัน

ข่าวเบ็ดเตล็ด: Meta, Notion และ Dig

นอกจากข่าวใหญ่ Matt Wolfe ยังสรุปอัปเดตย่อยอีกหลายชิ้น เริ่มจาก Meta ที่เพิ่ม incognito chat ใน WhatsApp ทำให้ผู้ใช้คุยกับ Meta AI ใน WhatsApp ได้โดยไม่ถูกบันทึก ระบบประมวลผลบทสนทนาแบบ incognito ในสภาพแวดล้อมที่ปลอดภัย แม้แต่ Meta ก็มองไม่เห็น และบทสนทนาจะหายไปเองโดย default ตามที่ Matt Wolfe ระบุ ฟีเจอร์ลักษณะนี้ Claude, OpenAI และ X มีมาก่อนแล้ว

ถัดมาคือ Notion ที่ปล่อย Notion developer platform สำหรับนักพัฒนา ประกอบด้วย Notion CLI ที่สั่งงาน Notion จาก terminal ได้ ระบบ worker ที่รันโค้ดบน infrastructure ของ Notion, database sync, agent tool, web hook trigger, external agents API และ Notion agents SDK ตามที่ Matt Wolfe นำเสนอ แพลตฟอร์มนี้ทำให้นักพัฒนาสร้างแอปหรือทำงานกับ Notion จาก terminal ได้โดยตรง หรือมอบสิทธิ์ให้ agent อย่าง OpenClaw หรือ Hermes เข้าไปทำงานใน Notion แทนได้

ปิดท้ายด้วย Dig ซึ่ง Matt Wolfe เล่าว่า Dig.com เว็บ social ที่เกิดก่อน Reddit ดัง กลับมาเปิดตัวใหม่อีกครั้ง คราวนี้เป็นความร่วมมือระหว่าง Kevin Rose หนึ่งในผู้ก่อตั้ง Dig และ Alexis Ohanian หนึ่งในผู้ก่อตั้ง Reddit แพลตฟอร์มใหม่นี้วิเคราะห์ว่าหัวข้อไหนกำลังร้อนบน X จากเสียงของบุคคลในวงการ AI ราว 2,000 คน แล้วนำมาจัดอันดับให้ ตามที่ Matt Wolfe อธิบายไว้ในคลิป

ที่มา: Matt Wolfe: AI News: Impressive New Model From Unexpected Company (YouTube, 15 พ.ค. 2026)

ความคิดเห็น

ยังไม่มีความคิดเห็น เป็นคนแรกที่แสดงความเห็น!