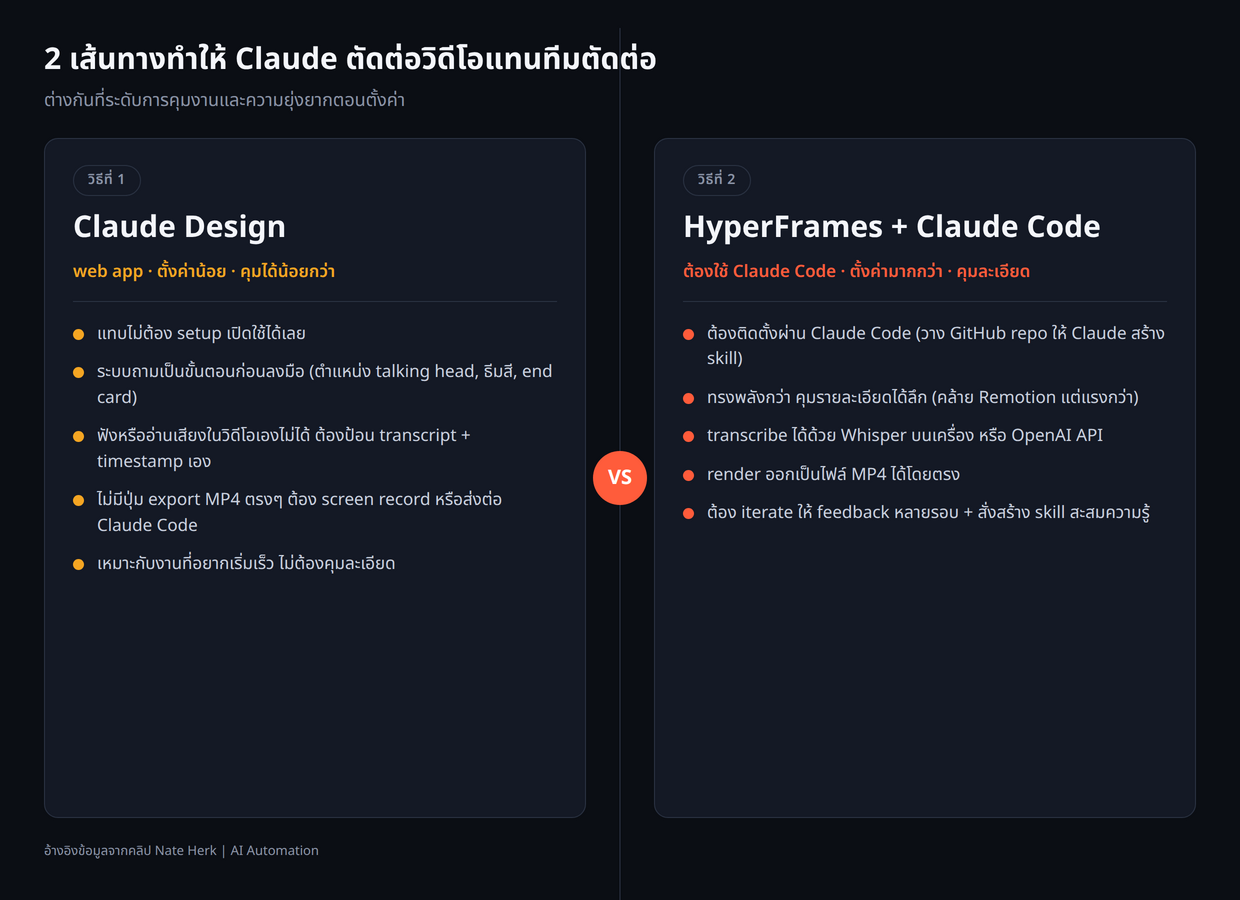

ช่อง Nate Herk | AI Automation เผยแพร่คลิปที่ระบุว่า Claude กลายเป็น "ทีมตัดต่อวิดีโอ" ที่สั่งงานด้วยภาษาธรรมชาติล้วน ในคลิปสาธิตการใส่ text บนหน้าจอ ซับไตเติลด้านล่าง motion graphic แผนภูมิ และการขยับตำแหน่งหน้าผู้พูดในเฟรม ทั้งหมดทำได้โดยไม่ต้องเขียนโค้ด ตามที่ Nate Herk นำเสนอ คลิปสั้นราว 23 วินาทีที่ใช้สาธิตช่วงเปิด ถ้าตัดต่อด้วยมือจะใช้เวลาราว 2 ชั่วโมง ทีมตัดต่อของเขาเองยังให้ความเห็นว่าวิธีนี้เปลี่ยนรูปแบบการทำงานไปอย่างชัดเจน คลิปแบ่งการสาธิตออกเป็น 2 เส้นทางหลัก คือ Claude Design ที่เป็น web app และ HyperFrames ที่ทำงานร่วมกับ Claude Code บทความนี้จึงสรุปสาระสำคัญจากคลิปดังกล่าว เพื่อให้เห็นภาพรวมว่าแต่ละวิธีทำอะไรได้ และมีขีดจำกัดตรงไหน

Claude เป็นทีมตัดต่อวิดีโอที่สั่งด้วยภาษาธรรมชาติ

ในคลิปของ Nate Herk | AI Automation ระบุว่าจุดที่ทำให้เรื่องนี้น่าสนใจคือ งานที่เคยต้องทำ key frame และ animate motion graphic ด้วยมือจนกินเวลานานมาก กลับสั่งให้ Claude ทำได้ด้วยการพิมพ์บอกเป็นภาษาธรรมชาติ Nate Herk ยกตัวอย่างคลิป "HyperFrames sizzle" ที่เขาสร้างขึ้นเพื่อโชว์ศักยภาพ คลิปนี้มีทั้งอนิเมชันสไตล์ terminal โทรศัพท์เด้งขึ้นมา การไล่ชุดสี การดึง font ของ Anthropic เข้ามาใช้ และซับไตเติลสไตล์คาราโอเกะที่ sync กับเสียงพูด เบื้องหลังคือการแปลง HTML ในเบราว์เซอร์ ส่งต่อให้ FFmpeg แล้วออกมาเป็นไฟล์ MP4

ตามที่ Nate Herk นำเสนอ ตัวอย่างอีกชิ้นชื่อ "first agent promo" สร้างใน Claude Design โดยเริ่มจากเว็บไซต์ที่เขาทำไว้ก่อน จากนั้น export ออกมาเป็น standalone HTML แล้วนำ HTML ก้อนนั้นหย่อนกลับเข้าไปในโปรเจกต์ใหม่ พร้อมสั่งให้เปลี่ยนเป็นวิดีโอเปิดตัวแบบมีอนิเมชัน ผลที่ได้คือวิดีโอที่แบรนด์ดิ้ง สี และ font ตรงกับเว็บไซต์จริงทั้งหมด คลิปชี้ว่าคลิปความยาวราว 30 วินาทีลักษณะนี้ ถ้าตัดต่อด้วยมือจะใช้เวลาหลายชั่วโมง นอกจากนี้ Nate Herk ยังระบุว่าเขาเตรียม repo และ skill สำหรับตั้งค่าทั้งหมดแจกให้ใช้ฟรีผ่านคอมมิวนิตีของเขา

วิธีที่ 1: Claude Design กับข้อจำกัดเรื่องเสียงและ transcript

คลิปของ Nate Herk | AI Automation อธิบายว่า Claude Design คือ web app ที่ไม่ได้ทำได้แค่เว็บไซต์และสไลด์ แต่ animate สิ่งต่างๆ ได้ด้วย จุดเด่นที่ Nate Herk ชี้คือ ระบบจะถามคำถามเป็นขั้นตอนก่อนลงมือทำ เช่น ตำแหน่งของ talking head ควรอยู่ตรงไหน ระดับพลังงานของภาพ ชนิดของ motion graphic ธีมสี และ end card CTA จากนั้นจึงเริ่มสร้างวิดีโอให้ เพราะ Nate Herk ตั้งค่า design system ของแบรนด์ตัวเองไว้ ระบบจึงเข้าใจโลโก้ สี และ typography แล้วสร้างงานที่หน้าตาตรงกับเว็บไซต์จริงได้

แต่คลิประบุข้อจำกัดสำคัญไว้ชัดเจน คือ Claude Design อ่านหรือฟังเสียงในวิดีโอเองไม่ได้ เรื่องนี้สำคัญมากเวลา animate วิดีโอที่มีคนพูด เพราะ motion graphic ต้องเข้ามาในจังหวะที่ตรงกับสิ่งที่พูด ทางแก้ตามที่ Nate Herk นำเสนอคือ ต้องป้อน transcript ของวิดีโอพร้อม timestamp คร่าวๆ เข้าไปเอง ในตัวอย่างของเขาใช้ไฟล์ JSON ที่ถอดเสียงทั้งวิดีโอแบบคำต่อคำพร้อม timestamp ไว้แล้วในโปรเจกต์ Claude Code จึงคัดลอกไปวางใน Claude Design ได้ทันที

นอกจากนี้ Nate Herk ยังชี้อีกข้อจำกัดหนึ่งคือ Claude Design ไม่มีปุ่ม export เป็น MP4 โดยตรง วิธีรับไฟล์ออกมาตามที่คลิประบุมี 2 ทาง คือ เปิดเต็มจอแล้ว screen record เอง หรือถ้าเป็นวิดีโอยาว ให้ส่งต่อ (hand off) ไปที่ Claude Code โดยคัดลอกคำสั่งที่ระบบให้มา แล้วสั่งให้ Claude render เป็น MP4 วิธีนี้เป็นวิธีเดียวกับที่เขาใช้ทำ "first agent promo" คลิปสรุปว่า Claude Design เป็นตัวเลือกที่ใช้งานได้จริง เพราะเบื้องหลังของงานลักษณะนี้คือการสร้าง HTML และ Claude Design ทำ HTML รวมถึง animate HTML ได้ดีมาก

วิธีที่ 2: HyperFrames กับ Claude Code ที่คุมได้ละเอียดกว่า

ถ้าต้องการคุมงานละเอียดขึ้น คลิปของ Nate Herk | AI Automation แนะนำ HyperFrames ซึ่งเขาอธิบายว่าเป็นเครื่องมือคล้าย Remotion แต่ทรงพลังกว่า แลกกับการตั้งค่าที่มากกว่า การใช้งานต้องอาศัย Claude Code โดยใช้ได้ทั้งใน VS Code และ Claude desktop app ตามที่ Nate Herk นำเสนอ ข้อดีของ Claude desktop app คือมีฟังก์ชัน preview ดูวิดีโอในแอปได้ ส่วนข้อดีของ VS Code คือเห็นไฟล์ assets และ renders ทั้งหมดในโปรเจกต์

วิธีติดตั้งตามที่คลิประบุคือ เข้าไปที่ repo ของ HeyGen HyperFrames คัดลอก URL ของ GitHub repo นั้น นำไปวางใน Claude Code แล้วสั่งให้ Claude วิเคราะห์ repo สร้าง skill และความรู้เกี่ยวกับวิธีทำงาน จากนั้นช่วยติดตั้งให้ Nate Herk ย้ำว่าหัวใจของเครื่องมือลักษณะนี้คือการ iterate กล่าวคือ ระบบให้ผลลัพธ์มา ผู้ใช้บอกว่าชอบอะไร ไม่ชอบอะไร แล้วให้แก้ ทำซ้ำไปเรื่อยๆ ทุกครั้งที่ทำงานควรสั่งให้ Claude สร้าง skill หรือ design doc สะสมไว้ด้วย เพื่อให้สตูดิโอตัดต่อใน Claude Code ดีขึ้นทุกครั้งที่สร้างวิดีโอ

ในขั้นตอน transcribe คลิประบุว่า HyperFrames ทำได้ 2 ทาง คือ ติดตั้ง Whisper บนเครื่องผ่าน Python หรือถ้ากิน RAM มากเกินไป ให้ใช้ OpenAI API กับ Whisper แทน Nate Herk เล่าว่าเขาเลือกถอนการติดตั้งตัวบนเครื่องออก เพราะตอนรันหลายวิดีโอพร้อมกันมันกิน RAM หนัก ความแตกต่างหลักระหว่าง 2 วิธีจึงอยู่ที่ระดับการควบคุมและความยุ่งยากในการตั้งค่า ดังสรุปในแผนภาพต่อไปนี้

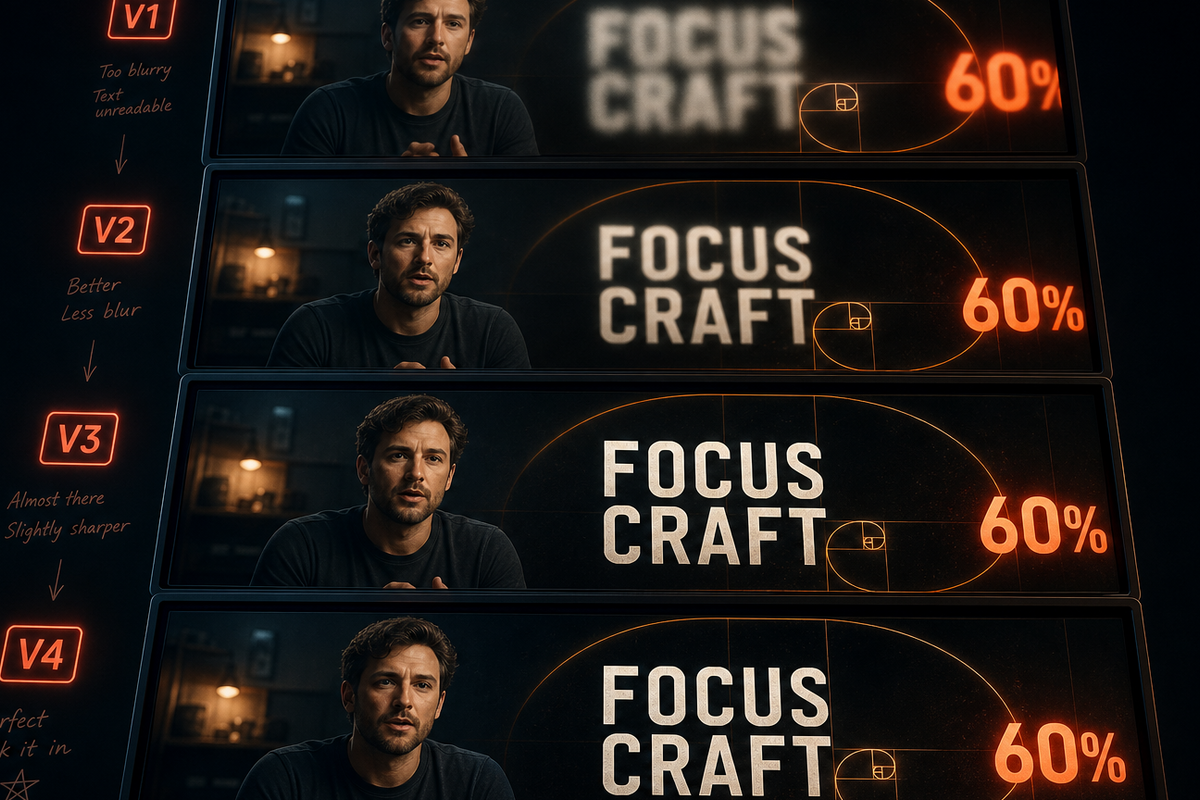

ตัวอย่าง live build: golden ratio demo กับการแก้ 4 รอบ

คลิปของ Nate Herk | AI Automation สาธิตการสร้างวิดีโอจริงด้วย skill ชื่อ "make a video" ใน Claude Code โดยหย่อนคลิป "golden ratio demo" ความยาว 37 วินาทีเข้าไป Nate Herk อธิบายว่าเมื่อเรียก skill ระบบจะเริ่มสัมภาษณ์เพื่อทำความเข้าใจวิดีโอก่อน เช่น วิดีโอเป็นแนวนอน 60 FPS 37 วินาที 2,259 เฟรม จากนั้นจะ sample เฟรมมาดูว่าวิดีโอมีอะไร แล้วถามต่อว่าต้องการให้เป็นแบบ face พร้อม motion graphic overlay หรือแบบ course ที่หน้าผู้พูดอยู่มุมล่างขวา รวมถึงถามว่าจะให้ transcribe เพื่อดึง timestamp ระดับคำหรือไม่

ตามที่ Nate Herk นำเสนอ เมื่อระบบเสนอแผน (plan) แล้ว ควรใช้เวลาตรวจขั้นตอนนี้ให้ดี เพราะเมื่อเริ่มสร้าง motion graphic ระบบจะเขียน HTML จำนวนมาก และใช้ output token เยอะ หากอนุมัติแผนแล้วไม่ชอบผลลัพธ์ จะเสีย token เพิ่ม คลิปยังชี้ว่าถ้านำวิดีโอดิบที่ยังไม่ตัดมาใส่ ควรตัดจุดที่พูดผิดหรือช่วงเงียบออกก่อน เพราะระบบยังตีความได้ไม่ดีว่าตรงไหนคือจุดเริ่มประโยคใหม่ และตรงไหนคือจุดที่พูดพลาด

จุดที่คลิปเน้นมากคือกระบวนการให้ feedback Nate Herk ระบุว่าวิธีให้ feedback เหมือนกับการบอกคนตัดต่อวิดีโอที่เป็นมนุษย์ คือระบุว่า timestamp ไหนไม่ชอบอะไร และชอบอะไรแทน ในตัวอย่าง golden ratio demo มีปัญหา blur ทับข้อความ hero title จนอ่านไม่ออก และเลข 60% หลุดเฟรมบางส่วน Nate Herk ให้ feedback โดยระบุ timestamp ชัดเจน ระบบจึงไล่แก้ทีละรอบจาก V1 ไป V2, V3 จนถึง V4 ซึ่งเป็นเวอร์ชันสุดท้ายที่ใช้งานได้ คลิปยังแนะนำเทคนิคหนึ่งคือ ตั้งค่าให้ระบบตรวจทุกเฟรมก่อน render หรือก่อนส่งผลลัพธ์ให้ดู เพื่อให้แก้ปัญหาด้วยตัวเองได้ก่อน

Tip: ตามที่คลิประบุ ก่อนเริ่มรอบ feedback ใหม่ Nate Herk ขอให้ระบบสรุปงานที่สร้างไว้และตำแหน่งไฟล์ จากนั้น clear session แล้ววางสรุปนั้นกลับเข้าไป เพื่อไม่ให้แก้งานทับ context ที่สะสมไว้ 263,000 token

ต้นทุน token เวลา และขีดจำกัดที่คลิปย้ำ

ในช่วงท้าย คลิปของ Nate Herk | AI Automation สรุปเรื่องต้นทุนและความเร็ว Nate Herk ตรวจ context ด้วยคำสั่ง context พบว่ารอบแรกใช้ราว 260k token และอีกรอบใช้ 125k เขาเริ่มโปรเจกต์ที่ระดับการใช้งาน 20% และทั้งโปรเจกต์นี้ใช้ไปราว 10% ของ limit 5 ชั่วโมง บนแพ็กเกจ max 200 ดอลลาร์ต่อเดือน ตามที่ Nate Herk ระบุ สาเหตุที่กิน token คือระบบเขียน output ที่เป็นโค้ดจำนวนมาก แต่ถ้าทำตาม best practice และ clear session เป็นระยะ จะลดการใช้ token ลงได้มาก

นอกจากนี้ คลิปยังย้ำขีดจำกัดด้านฮาร์ดแวร์ Nate Herk เล่าว่าตอนอัปโหลดคลิปก่อนหน้าเกี่ยวกับ Claude Design หน้ากล้องของเขากระตุก เพราะตอนนั้น render วิดีโอ 4 ตัวพร้อมกันจน CPU และ RAM ทำงานหนัก ข้อแนะนำตามที่คลิประบุคือ ควร render ทีละตัว ระหว่างทดลอง Nate Herk ยังยอมรับว่าบาง preview บน localhost มีปัญหาแสดงเป็น 0 วินาที จึงต้องสั่งให้ระบบ render เต็มแล้วค่อยให้ feedback แทน

คลิปสรุปด้วยมุมมองสำคัญว่า เครื่องมือเหล่านี้ช่วยให้คนที่ตัดต่อเป็นและมีรสนิยมการออกแบบที่ดีอยู่แล้ว เพิ่มผลิตภาพได้หลายเท่า เพราะผู้ใช้เป็นคนใส่แนวคิดเรื่องการ animate และทักษะการออกแบบของตัวเองเข้าไปกำกับผลลัพธ์ ส่วนตัวอย่างที่ Nate Herk ลองแล้วยังไม่เวิร์ก เช่น product demo ของ ClickUp และคลิป short-form เขายอมรับตรงๆ ว่ายังไม่ถึงระดับที่จะโพสต์จริง แต่เชื่อว่าถ้า iterate ต่อไปเรื่อยๆ จะดีขึ้นได้ ทั้งหมดนี้เป็นการสรุปสาระจากคลิปต้นฉบับ ผู้สนใจสามารถดูรายละเอียดและการสาธิตเต็มได้จากคลิปของ Nate Herk | AI Automation โดยตรง

ที่มา: Nate Herk | AI Automation: Claude Just Destroyed Every Video Editing Tool (YouTube, 18 เม.ย. 2026)

ความคิดเห็น

ยังไม่มีความคิดเห็น เป็นคนแรกที่แสดงความเห็น!